Zdjęcie: Adobe Stock

Zdjęcie: Adobe Stock

Nawet skomplikowaną maszyną można sterować jak marionetką. Eksperci cybernetyki nazywają to „złośliwym atakiem przeciwnika”. To powód, dla którego naukowcy, w tym ci z Wojskowej Akademii Technicznej, badają manewry przeciwnika – stwierdził płk dr inż. Rafał Kasprzyk z Wojskowej Akademii Technicznej podczas wystąpienia w Studiu PAP.

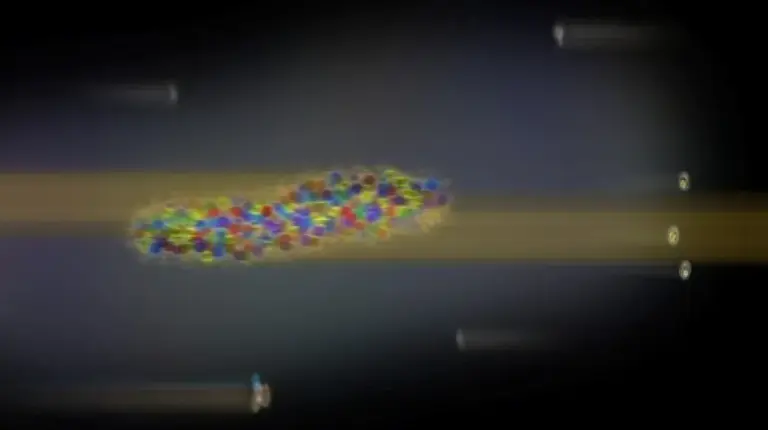

„W kontekście humanistycznym sztuczna inteligencja reprezentuje „ciepło”, jakie algorytmy wnoszą do zimnych układów scalonych. Algorytmy te pobudzają obwody, co prowadzi do pojawienia się nowego bytu, sztucznej inteligencji. Niektórzy postrzegają ją jako iluminację, podczas gdy inni widzą w niej cień, złowieszcze odbicie przyszłości, które manifestuje się w teraźniejszości. Osobiście uważam ją za narzędzie, które wzmacnia naszą własną inteligencję” – wyjaśnia inżynier.

Podkreśla, że to narzędzie szybko zyskuje autonomię. Siłą napędową algorytmów AI są dane, a ich skuteczność zależy od mocy obliczeniowej współczesnych komputerów. Zadaje również intrygujące pytanie, czy ten nowy byt mógłby kiedyś zastanowić się nad swoją własną tożsamością.

Rozwój algorytmów sztucznej inteligencji postępuje w tempie wykładniczym.

„Klasyfikacja jest podobna do próby naniesienia na mapę kontynentu, który pozostaje nieodkryty. Co więcej, możemy nawet nie zdawać sobie sprawy, że mogą istnieć inne kontynenty” — zauważa badacz. Jako inżynier dzieli AI na dwa odrębne typy. Pierwszy to taki, który jest szkolony przez eksperta — osobę, która rozumie maszynę i przekazuje znane reguły „jej umysłowi”. Drugi to system, który uczy się niezależnie, wykorzystując otrzymywane dane. W ten sposób rozwija się Oprogramowanie 2.0, które obecnie znajduje coraz bardziej intrygujące zastosowania i przewyższa ludzi w różnych dziedzinach.

Wyzwanie polega na tym, że „nie do końca rozumiemy zasady rządzące zachowaniem tej maszyny. Choć wiemy, jak je skonstruować i rozumiemy algorytmy, możemy jedynie spekulować; nie możemy definitywnie stwierdzić, jaką decyzję podjęłaby maszyna wyszkolona w ten sposób ani jakie były powody takiego wyboru” – przyznaje płk dr inż. Kasprzyk.

Zauważa, że istnieje wiele dziedzin, szczególnie w wojsku, w których niedozwolone jest wykorzystywanie maszyn, których zasady działania nie są w pełni zrozumiałe.

ŚRODKI WALKI ZAPAKOWANE W SENSORY

Gwałtownie rosnąca popularność AI jest związana z dużymi modelami językowymi, które uczą się autonomicznie z danych „słownikowych” dostępnych online. Modele multimodalne czerpią informacje nie tylko z tekstu, ale także z obrazów, dźwięków i wszelkiego rodzaju danych zbieranych przez czujniki — podobnie jak ludzie zbierają informacje za pomocą zmysłów. Jak ujawnia płk dr inż. Kasprzyk, inżynierowie takich modeli „czujnikują” wszystko szeroko, gromadząc wszystkie możliwe dane przed rozważeniem ich potencjalnych zastosowań.

Jednocześnie opracowują algorytmy do bieżących zastosowań, zwłaszcza w wojsku, gdzie AI pomaga uzyskać przewagę nad potencjalnym przeciwnikiem, nie tylko na polu bitwy. Na przykład, wzmacnia zdolności rozpoznawcze, tym samym wspierając świadomość sytuacyjną.

„Algorytmy uczenia maszynowego mogą dokładnie i szybko identyfikować podejrzane obiekty, rozpoznawać je i śledzić ich ruchy. Stanowi to jedno z „głównych zastosowań”, które rozciąga się również na konteksty cywilne, takie jak pojazdy autonomiczne. W sferze wojskowej jednak koncentruje się na zbieraniu danych i konstruowaniu kompleksowego obrazu sytuacji” – wyjaśnia pułkownik, wyjaśniając, że zdolność do integrowania danych z licznych czujników osadzonych w nowoczesnych zasobach bojowych zwiększa skuteczność dowodzenia.

ULEPSZA, DORADZA, NIE ZASTĘPUJE

Sugerowanie dowódcom optymalnych kierunków działań to kolejna droga do zastosowania AI na polu bitwy. Dowódca może zdecydować się na działanie zgodnie z takimi zaleceniami lub nie. „Mam nadzieję, że nigdy nie pójdziemy w tym kierunku” – twierdzi pułkownik. Niemniej jednak wyraża silne przekonanie o roli obrony i ochrony wojsk.

„Sztuczna inteligencja może być wykorzystywana do wszystkich zadań, które są nieprzyjemne, żmudne lub niebezpieczne, takich jak rozminowywanie. Autonomiczne lub zdalnie sterowane pojazdy obsługiwane przez algorytmy AI mogą wykonywać te zadania zamiast ludzi. Roboty mogą również zaciemniać teren, potencjalnie myląc wrogie pociski” – wymienia inżynier, zauważając, że drony mogą służyć jako środek maskowania, co otwiera cały szereg wyzwań dla naukowców w zakresie zarządzania wieloma małymi podmiotami. Zastosowania wojskowe obejmują również logistykę, łańcuchy dostaw i analizę potrzeb zarówno personelu, jak i sprzętu.

TYLKO CZŁOWIEK JEST WCIĄŻ STRZELANY

Największa intryga wokół zastosowań AI leży w domenie wpływu, która jest krytyczna dla prowadzenia wojny. W końcu armia musi priorytetowo traktować nie tylko rozpoznanie, ochronę i zaopatrzenie, ale także niszczenie celów.

„Na szczęście, przynajmniej na razie, nie ma autonomicznych systemów śmiercionośnej broni w użyciu” – komentuje płk dr inż. Kasprzyk. Jednak niepewność, czy tak pozostanie w przyszłości, utrzymuje się. Być może jedna ze stron konfliktu zdecyduje się na taki krok, albo maszyna może samodzielnie podejmować decyzje w przypadku braku komunikacji z ludźmi.

W cyberprzestrzeni — obejmującej internet i wszelkie formy komunikacji — sztuczna inteligencja może identyfikować słabości w telekomunikacyjnym systemie wroga. Wojska mogą również wykorzystywać ją do analizowania własnych systemów w celu ich „wzmocnienia”, wskazując i zamykając wszelkie „tylne drzwi”, które mogłyby zostać wykorzystane przez przeciwników — znane luki.

WOJNY ALGORYTMÓW

Jak wyjaśnia płk dr inż. Kasprzyk, wprowadzenie oprogramowania do walki wzmacnia siły, ale także poszerza powierzchnię ataku. Luki czasami pojawiają się niekontrolowanie, ale inżynierowie mogą również celowo tworzyć tylne furtki w trakcie procesu rozwoju.

Złożoność wzrasta wraz z algorytmami sztucznej inteligencji, jak zauważa ekspert. „Biorąc pod uwagę, że nie rozumiemy w pełni najnowszych dużych modeli zbudowanych z głębokich architektur sieci neuronowych, mogą one posiadać luki, które pozostają przed nami ukryte. Mogą być one również ukryte przed przeciwnikami, przynajmniej początkowo. Mogą jednak zostać odkryte i ujawnione za pomocą innych algorytmów uczenia maszynowego, co wprowadza to, co można nazwać wojną maszynową” — stwierdza.

Źródło